Pruna AI, европейский стартап, который работал над алгоритмами сжатия для моделей искусственного интеллекта, делает свою структуру оптимизации открытым исходным кодом в четверг.

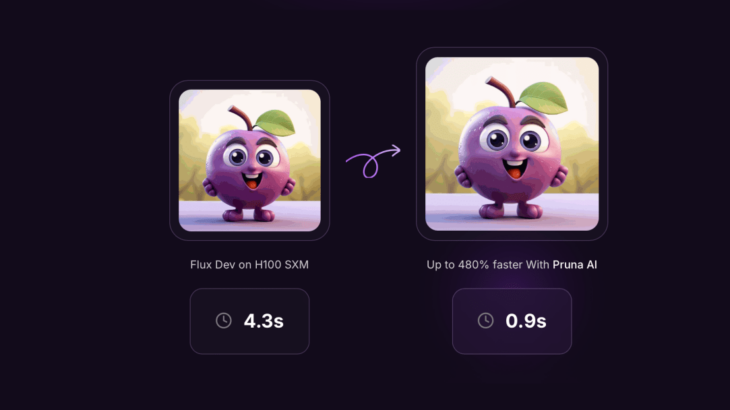

Pruna AI создает структуру, которая применяет несколько методов эффективности, таких как кэширование, обрезка, квантование и дистилляция, к данной модели ИИ.

«Мы также стандартизируем сохранение и загрузку сжатых моделей, применяя комбинации этих методов сжатия, а также оцениваем вашу сжатую модель после ее сжатия»,-сказал TechCrunch, Pruna AI Co-Fonder и технический директор Джон Рачван.

В частности, структура Pruna AI может оценить, есть ли значительная потеря качества после сжатия модели и получения производительности, которые вы получаете.

«Если бы я использовал метафору, мы похожи на то, как обнимание сталкивается с стандартизированными трансформаторами и диффузорами — как их позвонить, как их сохранить, загрузить их и т. Д. Мы делаем то же самое, но для методов эффективности», — добавил он.

Большие лаборатории ИИ уже используют различные методы сжатия. Например, OpenAI полагается на дистилляцию, чтобы создать более быстрые версии своих флагманских моделей.

Вероятно, это то, как OpenAI разработал GPT-4 Turbo, более быструю версию GPT-4. Точно так же модель генерации изображений Flux.1-Schnell представляет собой дистиллированную версию модели Flux.1 от Brandest Labs.

Дистилляция-это метод, используемый для извлечения знаний из большой модели ИИ с моделью «учителя-ученика». Разработчики отправляют запросы в модель учителя и записывают выводы. Ответы иногда сравниваются с набором данных, чтобы увидеть, насколько они точны. Эти результаты затем используются для обучения модели студента, которая обучается приближать поведение учителя.

«Для крупных компаний они обычно делают то, что они строят этот материал на месте. И то, что вы можете найти в мире с открытым исходным кодом, обычно основано на отдельных методах. Например, скажем, один из методов квантования для LLMS или один метод кэширования для диффузионных моделей»,-сказал Рачван. «Но вы не можете найти инструмент, который объединяет их все, делает их все простыми в использовании и объединяется вместе. И это большая ценность, которую Пруна сейчас приносит».

Слева направо: Райан Нейт Мази, Бертран Чарпентье, Джон Ракван, Стефан ГюннеманнКредиты изображения:Пруна у вас есть

В то время как Pruna AI поддерживает любые модели, от крупных языковых моделей до диффузионных моделей, моделей речи к тексту и моделей компьютерного зрения, компания сейчас фокусируется более конкретно на моделях генерации изображений и видео.

Некоторые из существующих пользователей Pruna AI включают сценарий и фотобурку. В дополнение к изданию с открытым исходным кодом, Pruna AI имеет предприятие, предлагающее предприятия с расширенными функциями оптимизации, включая агент оптимизации.

«Самая захватывающая особенность, которую мы выпускаем вскоре, станет агентом по сжатию», — сказал Рачван. «По сути, вы даете ей свою модель, вы говорите:« Я хочу большую скорость, но не снижайте свою точность более чем на 2%». И тогда агент просто сделает свою магию.

Pruna AI взимает за час за свою профессиональную версию. «Это похоже на то, как вы думаете о графическом процессоре, когда арендуете графический процессор на AWS или в любом облачном сервисе», — сказал Рачван.

И если ваша модель является важной частью вашей инфраструктуры искусственного интеллекта, вы в конечном итоге сохраните много денег на вывод с оптимизированной моделью. Например, Pruna AI сделала модель Llama в восемь раз меньше без слишком большой потерь, используя свою структуру сжатия. Pruna AI надеется, что ее клиенты будут думать о своей структуре сжатия как о инвестициях, которая окупается за себя.

Pruna AI собрал 6,5 млн. Долл. сша через несколько месяцев назад. Инвесторы в стартапе включают EQT Ventures, Daphni, Motier Ventures и Kima Ventures.