Firefly спонсировал этот пост.

Впервые за годы разработчики говорят, что работа снова кажется веселой.

Это не просто чувства. Это результат того, как существенные рабочие процессы AI изменили опыт разработки. С помощью инструментов редактирования кода ИИ, таких как курсор, модели больших языков (LLMS) больше не являются внешними помощниками; Они встроены в интегрированную среду разработки (IDE), работая вместе с разработчиками, чтобы уменьшить трение, устранить повторяющиеся закономерности и сохранить контекст там, где это принадлежит: в редакторе.

Этот подход, широко называемый кодированием Vibe, приоритет творческому потоку через шаблон. Речь идет не о создании большего количества строк кода. Вместо этого речь идет о том, чтобы тратить меньше времени на тех, кого никто не хочет писать. И это оказывает реальное влияние на то, как разработчики работают, сотрудничают и чувствуют себя в отношении своего ремесла.

За последние несколько месяцев кодирование Vibe перешло от любопытства к основной практике. Но даже несмотря на то, что он улучшает опыт разработки программного обеспечения, он все равно попадает в твердую стену.

MCP: недостающая связь между кодом и инфраструктурой

Разработка приложений, даже в рабочих процессах AI-первых, остается отключенной от инфраструктуры. В то время как ваш помощник по искусственному ИИ может генерировать блок терраформ или отлаживать фрагмент, он не понимает, что развернуто, что дрейфует или что уже существует. Конфигурации управления идентификацией и доступом (IAM), Службы сироты, Kubernetes State — этот контекст все живет в других инструментах, недоступных для LLM.

Это отключение ограничивает то, что возможно. Инструменты ИИ могут быть умнее, чем когда -либо, но они все еще работают без видимости. Вот что решает следующая эволюция.

Новое поколение инструментов, построенных вокруг модельного протокола контекста (MCP), стандарта с открытым исходным кодом, представленным Anpropic, меняет игру — соединение кода и инфраструктуры и предоставление агентам реальный доступ к реальному контексту.

MCP позволяет системам ИИ взаимодействовать со структурированными источниками данных, инструментами и даже другими агентами в едином, предсказуемом способе. Думайте об этом как о USB-C для LLMS: общий интерфейс, который позволяет AI-местным приложениям подключаться к реальным системам без сложных и пользовательских интеграций.

Этот подход быстро становится дефолтом.

На практике это означает, что любой продукт, совместимый с MCP, мгновенно становится доступным для растущей экосистемы агентов, поддерживающих LLM, аопилотов и рабочих процессов разработчиков. И это открывает дверь для широкого спектра использования, от генерации кодов, предупреждающих инфраструктуру в реальном времени, до полного автоматического восстановления в облачных средах.

Угол производительности разработчика: больше, чем скорость

Этот сдвиг имеет реальные последствия для производительности разработчиков не только с точки зрения скорости, но и того, как работают разработчики.

В традиционных рабочих процессах разработчиков доступ к облаку требует поиска, переключения инструментов и интерпретации полуструктурированных данных в разных системах. Это медленно, склонно к ошибкам и сложно масштабировать. Интеграция в такие инструменты, как курсор через MCP, меняет это. Когда агент LLM может получить точные, живые данные из вашего облачного стека в контексте — в середине сеанса кодирования — он устраняет догадки и резко сокращает цикл обратной связи.

Что еще более важно, это меняет роль разработчиков с исследователей на дизайнеров. Вместо того, чтобы тратить время на выяснение того, что существует, что сломалось или что дрейфовало, разработчики могут сосредоточиться на работе высшего порядка-решении проблем, оптимизации систем и уверенности в доставке, что их системы ИИ имеют свою спину.

И воздействие уже видно. Ранние пользователи, такие как Zoominfo и Hewlett Packard Enterprise (HPE), используют возможности MCP Firefly не только для разработки приложений, но и для ускорения рабочих процессов инженерии платформы-обеспечивая автоматизацию инфраструктуры как кодовой (IAC), которая реагирует на облачное состояние в реальном времени.

Разблокировка AI-коренных облачных операций с серверами MCP

Обещание развития AI не просто более быстрая итерация или чистая автозаполнение; Речь идет о включении систем, которые могут рассуждать в сложных средах, распределять приоритеты разумно и предпринять значимые действия. Но это обещание зависит от одной вещи: доступ к реальным данным.

Сейчас настало время использовать ИИ, где он превосходит его, разоблачив его на виды богатых, структурированных и динамических наборов данных, которые он может анализировать, суммировать, синтезировать и опираться. Это не ограничивается генерацией кода или анализом журнала. Он распространяется на инфраструктуру, управляющая нашими системами: политики, разрешения, рабочие нагрузки, топологии обслуживания и каждый сигнал, встроенный в облаке.

Вот где входят серверы MCP, такие как Firefly’s.

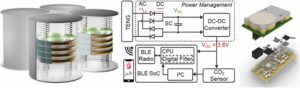

Вот пример: Firefly уже сохраняет глубоко индексированную инвентаризацию облачных сред, такие как рабочие нагрузки Kubernetes, конфигурации IAM и интеграции GitHub. До сих пор этот контекст был доступен через панели панели или API. Но в мире агента этого недостаточно. Таким образом, сервер Firefly MCP раскрывает эти данные, делая их доступными для любого инструмента или агента AI. Он превращает вашу инфраструктуру в живой, запрошенный интерфейс, доступный внутри вашей IDE, внутренних платформ автоматизации, таких как N8N или Inside Custom LLM -агенты, созданные для вашей организации.

Рост серверов MCP, подобных этим, отмечает переход от статической интеграции к динамической совместимости. Речь идет не о том, чтобы проталкивать данные между отключенными системами. Речь идет о том, чтобы позволить агентам работать на общей истине в режиме реального времени.

И как только это возможно, случаи использования быстро расширяются:

- Инфраструктурные копии, которые генерируют код на основе вашего фактического облачного состояния.

- Проверка времени дизайна против производственных конфигураций.

- Автоматизированное обнаружение дрейфа и восстановление, вызванное агентами

- Системы самовосстановления, управляемые живым запасом и логикой политики.

- Проактивная стоимость и оптимизация производительности с использованием контекста с использованием использования.

Это не только лучшая интеграция. Речь идет о разблокировке следующего уровня развития AI-коренного развития: где облачный контекст не является запоздалой мыслью, а основополагающим введением для каждого решения, которое принимает агент или разработчик.

И этот вид инноваций — это то, что превращает облако из черного ящика в полезный, интеллектуальный интерфейс и открывает дверь для нового класса более умных систем, построенных с инфраструктурой в цикле с первого дня.

Но это просто поверхность.

Серверы MCP, такие как Firefly’s, готовы стать воротами между облаком и быстро расширяющейся агентской экосистемой. Каждый агент LLM с клиентом MCP теперь может взаимодействовать с вашей инфраструктурой — не догадываясь, а спрашивая. И как только этот интерфейс существует, варианты использования размножаются: IAC, основанный на реальности, восстановление инцидентов, возглавляемое агентом, системы самовосстановления, упреждающие оптимизации затрат и проверка архитектуры времени проектирования.

Речь идет не только о создании лучших приложений. Речь идет о создании более умных систем, где логика приложения, государство инфраструктуры и рассуждения искусственного интеллекта больше не являются изолированными доменами.

В этом мире облачные данные не являются бэкэнд -деталями; Это первоклассный вход.

Новый слой в стеке ИИ

Растущий импульс вокруг MCPS отражает более широкую реализацию: агенты ИИ столь же полезны, как и данные и контекст, к которым они имеют доступ. Поскольку все больше компаний принимают инструменты, первые агента, узкое место переходит от поколения к заземлению. Насколько легко агент может понять вашу среду?

Сервер Firefly MCP отвечает на этот вопрос. Он превращает ваш существующий инвентарь облаков в доступный интерфейс для любой AI-местной системы. Независимо от того, создаете ли вы пользовательский копило, интегрируете автоматизацию рабочих процессов или обеспечиваете реагирование на инцидент с АВС, Firefly делает ваши данные о инфраструктуре не только видимыми, но и полезными.

Это разблокирует модель, в которой каждый агент по искусственному искусству может быть обладает облачным, не заново изобретая вашу среду, а путем подключения к общему источнику истины. Это эволюция в том, как разработчики взаимодействуют с инфраструктурой: более быстрая, более контекстуальная и более интуитивно понятная.

Когда экосистема созревает, мы, вероятно, увидим растущий набор интеграций с мощностью MCP, которые объединяют облако, код, сотрудничество и автоматизацию в сплоченные переживания разработчиков.

Короче говоря: это новый интерфейс для вашего облака.

И это уже делает разработчиков не только быстрее, но и более сфокусированными, более уполномоченными и, в конечном счете, счастливее.

Firefly-это плоскость управления облаком, которая позволяет DevOps и командам инженеров платформы сканировать и обнаруживать весь свой облачный след, обнаружение облачных конфигураций, классифицировать активы с использованием политики как код и управлять одним инвентаризацией облачных ресурсов в разных кластерах и Kubernetes Clusters. Узнайте больше последних из Firefly Trending Stories YouTube.com/ThenewStack Tech Moving быстро, не пропустите эпизод. Подпишитесь на наш канал YouTube, чтобы транслировать все наши подкасты, интервью, демонстрации и многое другое. Группа подпишитесь с эскизом. Эран Биби является соучредителем и директором по продукту в Firefly. Имея многолетний опыт работы в чем -либо DevOps/SRE и безопасности, он заработал репутацию эксперта CI/CD и SRE и заядлый администратор облачных платформ и контейнерных сред …. Подробнее от Eran Bibi