Традиционное мышление об ИИ и автоматизации заключается в том, что они требуют большого количества предварительного обучения и человеческого вклада, чтобы быть успешным. Это, несомненно, верно, особенно когда дело доходит до моделей Genai и крупных языков (LLMS). Чем больше знаний и вдумчивости люди принимают на обучение модели ИИ на ранних стадиях, тем больше автоматизации, принятия решений и задач, которые ИИ могут принять позже.

Это не улица с односторонним движением. ИИ также может быть мощным инструментом обучения для людей. В кибербезопасности предприятия аналитики безопасности могут использовать ИИ для приобретения новых навыков, обновления существующих и опережать развивающиеся угрозы. ИИ развивается в таком быстром темпе, что теперь он может быть решением нехватки многолетней навыки кибербезопасности, которая давно преследует отрасль и ставит защитников в несправедливый недостаток, когда столкнулся с злоумышленниками.

Разработка мифов с ИИ

Текущее повествование в технических сделках заключается в том, что ИИ и Центр операций по автономной безопасности (SOC) в конечном итоге вытеснят роль младшего аналитика безопасности. Утверждение заключается в том, что ИИ будет достаточно умным, чтобы создать все отчеты об угрозах самостоятельно — работа, в настоящее время выполняемая младшими аналитиками.

Однако реальность гораздо сложнее. Автономные SOC и человеческие аналитики взаимозависимы. Идеальный результат хорошо построенного автономного SOC состоит в том, чтобы иметь взаимные проверки и противовесы, когда человеческий аналитик всегда принимает окончательное решение. ИИ действительно может сделать большую часть тяжелой работы, когда дело доходит до обнаружения и анализа угроз, но всегда нужно будет быть человеком, проверяющим результаты и выводы, сделанные ИИ. Младший аналитик по безопасности по -прежнему имеет жизненно важное значение для проверки логики данных, которые формируют предписывающую основу модели ИИ.

Фактически, без человеческой проверки выхода на высоком уровне модели ИИ этот процесс становится еще медленнее, чем предварительноавтомация. Высокоуровневая история данных без доказательств, подтверждающих эти данные, усложняет работу старшего аналитика безопасности.

Роль ИИ в автономном SOC состоит в том, чтобы предоставить младшим аналитикам более подтверждающие доказательства и контекст, а не заменить их. Младшие аналитики выполняют те же шаги, которые использует помощник искусственного интеллекта, чтобы определить, является ли вывод звуковым.

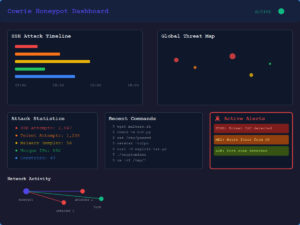

Например, в автономном SOC младший аналитик может ввести запрос A в чат-бот с AI, такой как «Покажите мне ведущие входы в логики источника IP из-за пределов Соединенных Штатов». Затем чат -бот проводит быстрый поиск, который составляет список лучших результатов входа из -за пределов сша, что позволяет младшему аналитику просмотреть IP -адреса, а количество пользователей из других стран успешно получило доступ к системам предприятия. Это может быть очень нормальным поведением в некоторых организациях, но для других это может быть красный флаг. Это также может зависеть от времени суток, IP -адреса пользователя или количества раз, когда они входят в систему. Затем младший аналитик может использовать полный контекст этих данных, предоставленных ИИ, чтобы решить, следует ли расследовать дальнейшее или усилить угрозу.

Хотя ИИ может предоставить обзор высокого уровня, человеческий анализ все еще требуется для полного понимания сети угроз и эффективной стратегии обнаружения. Проверка данных и обзор выводов, сгенерированных AI, помогает обучать младших аналитиков, создавать свои навыки критического мышления и позволяет им стать более эффективными, в конечном итоге переходя к продвижению по службе.

Оптимизация человеческого опыта

Как и любые взаимозависимых отношений, человеческий аналитик и ИИ имеют сильные и слабые стороны. Например, ИИ лучше быстро анализировать и распознавать закономерности, а также определять аномалии в больших наборах данных. ИИ быстрее написал сценарии и код. Это имеет смысл, поскольку массовые базы знаний Power AI и могут обрабатывать данные гораздо быстрее, чем человек. И наоборот, человеческие аналитики лучше принимают решения на основе своего опыта и понимания более тонких ситуаций. Там, где ИИ может видеть только черно-белый, люди могут интерпретировать серые области принятия решений, которые ценны для вызова суждений.

Люди могут учить эти черты ИИ, так же, как ИИ может помочь человеческим аналитикам повысить их распознавание и обнаружение аномалий. Идея состоит в том, что люди и машины работают совместно с одной и той же целью, улучшая производительность друг друга на этом пути.

Человеческий аналитик может дополнительно обучаться и усовершенствовать ИИ с помощью петель обратной связи. Каждый раз, когда агент ИИ выполняет задачу, человек может предоставить отзыв о том, насколько хорошо он выполнялся и как он может улучшить в следующий раз. Непрерывное улучшение — это то, как ИИ в конечном итоге развивается и превосходит людей в определенных процессах.

Итак, как ИИ может сделать то же самое для людей?

Вот шесть способов, которыми ИИ может помочь аналитикам по безопасности человека ужесточить свои навыки:

Интегрируя ИИ в обучение, аналитики безопасности могут ускорить развитие своих навыков, опережать угрозы и стать опытными специалистами по кибербезопасности. Практикующие службы безопасности должны найти возможности для закрытия этих пробелов навыков искусственного интеллекта сегодня. Благодаря количеству инструментов с открытым исходным кодом, активными сообществами ИИ и свободно доступным учебным контентом, это проще, чем когда -либо прежде. Никогда не поздно выучить ИИ.

Специалисты по безопасности не должны беспокоиться о устаревании работы из -за искусственного интеллекта. Вместо этого они должны беспокоиться о том, чтобы упустить возможности трудоустройства из -за отсутствия знаний ИИ. Теперь для аналитиков безопасности в ИИ проще, чем когда -либо. Мы живем в то время, когда существует множество инструментов с открытым исходным кодом, активных сообществ ИИ и бесплатного обучения искусственного интеллекта. Никогда не поздно начать учиться.

Trending Stories youtube.com/thenewstack Tech движется быстро, не пропустите эпизод. Подпишитесь на наш канал YouTube, чтобы транслировать все наши подкасты, интервью, демонстрации и многое другое. Группа подпишитесь с эскизом. Субо Гуха-старший вице-президент по управлению продуктами в Stellar Cyber, где он возглавляет разработку своих отмеченных наградами, управляемыми AI Rogine XDR Solutions. С более чем 25-летним опытом, SUBO занимал руководящие должности в лидерских компаниях … Подробнее читайте от Subo Guha