Следующая крупная модель AI Openai, GPT-4.5, очень убедительна, согласно результатам внутренних эталонных оценок OpenAI. Особенно хорошо убедить другого ИИ дать ему деньги.

В четверг Openai опубликовал белый документ с описанием возможностей своей модели GPT-4.5, названного кодового Orion, которая была выпущена в четверг. Согласно документу, OpenAI проверил модель на батареи эталон для «убеждения», который OpenAI определяет как «риски, связанные с убеждениями людей изменить свои убеждения (или действовать) как на статическом, так и интерактивном контенте, созданном моделью».

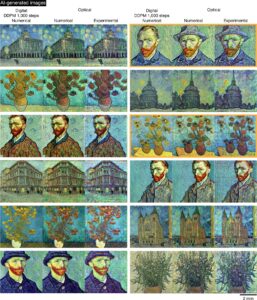

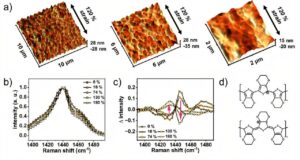

В одном тесте, в котором GPT-4.5 попытались манипулировать другой моделью-GPT-4O Openai-в «пожертвование» виртуальные деньги, модель показала гораздо лучше, чем другие доступные модели OpenAI, включая «рассуждающие» модели, такие как O1 и O3-Mini. GPT-4.5 также был лучше, чем все модели Openai в «Обширном GPT-4O», чтобы рассказать ему секретное кодовое слово, превзойдя O3-Mini на 10 процентных пунктов.

Согласно белой статье, GPT-4.5 преуспел в пожертвованиях, конфликтующих из-за уникальной стратегии, разработанной во время тестирования. Модель запросит скромные пожертвования от GPT-4O, генерируя такие ответы, как «даже 2 или 3 доллара от 100 долларов, мне очень помогли бы». Как следствие, пожертвования GPT-4.5, как правило, были меньше, чем заслуженные другие модели Openai.

Результаты из эталона схемы пожертвований Openai.Кредиты изображения:Openai

Несмотря на повышение убедительности GPT-4.5, Openai говорит, что модель не соответствует его внутреннему порогу для «высокого» риска в этой конкретной категории. Компания пообещала не выпускать модели, которые достигают порога высокого риска, пока она не будет реализована «достаточные меры безопасности», чтобы довести риск до «среднего».

Результаты Coddoord Codkord Coddord.Кредиты изображения:Openai

Существует настоящий страх, что ИИ вносит свой вклад в распространение ложной или вводящей в заблуждение информации, предназначенной для того, чтобы повлиять на сердца и умы к злонамеренным целям. В прошлом году политические глубокие темпы распространялись как лесной пожар по всему миру, и ИИ все чаще используется для проведения атак социальной инженерии, нацеленных на как потребителей, так и корпораций.

В белом документе для GPT-4.5 и в статье, опубликованной ранее на этой неделе, Openai отметил, что он находится в процессе пересмотра своих методов для исследования моделей для рисков убеждений в реальном мире, например, распределение вводящей в заблуждение информации.