Саммит Google Web AI прошел в начале этого месяца в Саннивейле, штат Калифорния, и был доступен только по приглашениям. После мероприятия я встретился с организатором Джейсоном Мэйесом, который возглавляет инициативы Web AI в Google.

В последний раз я брал интервью у Мэйса в феврале 2023 года, когда нашей основной темой разговора был TensorFlow.js — библиотека JavaScript для машинного обучения (ML). В то время, всего через пару месяцев после запуска ChatGPT, Мэйес использовал термин Web ML. Но сейчас модным термином является «Веб-ИИ». Я спросил Мэйса, когда произошло это изменение.

«Да, поэтому я изменил свое мнение, когда понял, что веб-разработчики ищут термин «веб-ИИ», потому что они не знают [term] машинное обучение», — усмехнулся он. По его мнению, Web ML более правилен с технической точки зрения, но вся отрасль предпочла использовать «ИИ», а не «ML».

В любом случае, тенденция веб-ИИ — и, по сути, основная тема мероприятия, которое только что провел Мэйс — в первую очередь касается управления клиентский ИИ в браузере. И это гораздо больше, чем TensorFlow.js; На мероприятии обсуждались и другие технологии: MediaPipe LLM, WebMCP, Transformers.js, Chrome Web AI API, WebAssembly (Wasm), WebGPU, WebNN и другие.

От TensorFlow.js до LiteRT.js для вывода в браузере

Фактически, TensorFlow.js сейчас менее широко применим и находится на пути к замене новой библиотекой под названием LiteRT.js (LT — сокращение от Lite Runtime). Это связано с тем, что фокус команды Мэйса сместился с поддержки обучения и вывода (что и делает TensorFlow.js) на сосредоточение внимания исключительно на выводе, для которого был разработан LiteRT.js.

«Итак, TensorFlow.js — это вывод и обучение», — сказал Мэйес. «Вы могли бы даже проводить обучение в браузере. Мы решили отказаться от обучения, чтобы сосредоточиться исключительно на выводе, потому что я думаю, что Python — это, по сути, лучший способ обучения, но возможность развертывания Интернета по-прежнему является здесь выигрышным фактором, а также охват, конфиденциальность и все такое. Итак, мы хотели создать библиотеку, которая действительно ориентирована на самый быстрый вывод в городе в такой ситуации».

«Мы хотели сделать библиотеку [LiteRT.js] это действительно сосредоточено на самом быстром умозаключении в городе [for browsers]».

— Джейсон Мэйес, руководитель Google Web AI

Другими словами, Google передал обучение моделей ИИ Python, вместо того, чтобы продолжать попытки продвигать для этого решение на JavaScript. Похоже, компания сделала ставку на то, что вывод — процесс принятия решения или прогноза на основе модели искусственного интеллекта — можно сделать более эффективно в браузере, а это означает, что он созрел для JavaScript.

Для дальнейшего пояснения: LiteRT.js — это среда выполнения веб-ИИ от Google, предназначенная для производственных веб-приложений. Он основан на LiteRT, который предназначен для запуска моделей машинного обучения непосредственно на устройствах (мобильных, встроенных или периферийных), а не на основе облачных вычислений. Таким образом, LiteRT.js — это специфичная для браузера реализация среды выполнения LiteRT, позволяющая делать выводы в браузере через WebAssembly и WebGPU.

Я спросил Мэйса, будет ли когда-нибудь JavaScript конкурировать с Python в качестве основного языка для использования с ИИ.

Он ответил, что из-за предвзятости академических кругов в отношении Python «вы увидите, что новейшие исследовательские модели сначала появляются на Python» и что обучение будет происходить на бэкэнде. Однако он считает, что появятся абстракции, которые позволят разработчикам Node.js и JavaScript взаимодействовать с моделями.

«Поэтому я думаю, что это позволит всем разработчикам JavaScript точно настроить модели или переобучить их для нужд своего бизнеса, а затем преобразовать эти модели в форму веб-ИИ», — сказал он, — «и это то, что на самом деле развертывается, особенно если они заботятся о конфиденциальности или стоимости».

Понимание «Агентного Интернета»

Как и все остальные, Мэйс в этом году увлеклась агентами ИИ. На Web AI Summit он предложил то, что он называет «агентным Интернетом».

«Я считаю, что на самом деле у нас будет Интернет, предназначенный как для людей, так и для агентов. Таким образом, точно так же, как нам пришлось перейти от настольного компьютера к мобильному, когда был изобретен смартфон, я думаю, что нам нужно перейти от человека к человеку и агенту теперь, когда агенты, по сути, изобретены».

Для разработчиков JavaScript WebMCP «может быть лучше, чем оригинальный MCP». [Model Context Protocol]».

— Джейсон Мэйс

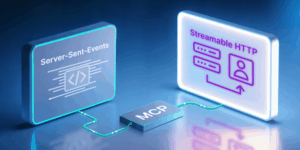

Он указывает на новый стандарт WebMCP, над которым работают Google и Microsoft, как на индикатор того, как идут дела. Он предполагает, что для разработчиков JavaScript WebMCP «может быть лучше, чем оригинальный MCP». [Model Context Protocol]».

WebMCP, как я обнаружил во время разговора с Кайлом Пфлюгом из Microsoft в конце сентября, похож на настройку сервера MCP для вашего веб-сайта или приложения, за исключением того, что функциональность, которую предоставляет WebMCP, осуществляется на стороне клиента, а не на сервере.

«Оригинальная версия MCP во многом разработана людьми, которые никогда не пользовались Интернетом», — сказал Мэйес. «Это своего рода экосистема командной строки на серверной части, и похоже, что они только что впервые открыли для себя протокол REST. Очевидно, мы используем его уже много лет на веб-сайте. Так что, возможно, мы можем сделать что-то получше для стандартов связи в Интернете, внешнего интерфейса и JavaScript; и там [are] более эффективные способы аннотирования вашего веб-сайта, чтобы браузеры и другие агенты могли обнаружить инструменты, которые вы предоставляете на своем веб-сайте, по сравнению с инструментом командной строки».

«Представьте, что на каждом веб-сайте есть аннотации по инструментам, которые он предоставляет».

— Джейсон Мэйс

Мэйс считает, что WebMCP и подобные агентские инструменты приведут к созданию приложений ИИ, которые выйдут далеко за рамки чат-ботов, которые определили первую волну генеративного ИИ (GenAI) в 2023 и 2024 годах.

«Представьте, что каждый веб-сайт снабжен аннотациями по инструментам, которые он предоставляет», — предложил он в качестве мысленного упражнения. «Я считаю, что вместо рекламы в будущем — я имею в виду, что реклама все еще будет существовать, но вместо одной только рекламы — компании, предлагающие какие-либо услуги… будут предлагать интерфейс WebMCP (или что-то в этом роде), понятный браузеру, так что они смогут предлагать работу, когда пользователи попросят что-то сделать».

Браузер как человеческий интерфейс для ИИ

Помимо агентов и MCP, 2025 год также стал годом браузеров с искусственным интеллектом. Microsoft Edge получил «режим второго пилота» в июле, затем в сентябре Google анонсировал множество новых функций искусственного интеллекта в Chrome (с дальнейшими «агентскими возможностями», которые будут добавлены в ближайшие месяцы), и, конечно же, в прошлом месяце OpenAI анонсировала свой новый браузер Atlas, который присоединяется к аналогичным браузерам на основе чата на рынке, таким как Comet от Perplexity и Dia от Browser Company (теперь принадлежащий Atlassian). Учитывая новую направленность браузеров на искусственный интеллект, я спросил Мэйса, ожидает ли он, что веб-браузеры станут человеческим интерфейсом для агентов искусственного интеллекта.

«Есть причина, по которой все эти штуки с GenAI начались с веб-браузера».

— Джейсон Мэйс

«Это отправная точка ко всему этому», — согласился он. «Браузер — единственное место, где вы вошли во все те вещи, из которых вы, возможно, захотите использовать WebMCP. [website owners] просто правильно аннотируйте их сайты, когда вы просматриваете Интернет, браузер обнаруживает инструменты, которые имеют отношение к вам, а не централизованное хранилище с, например, миллиардом инструментов, что делает его парадоксом выбора, [where] вы не можете выбирать, какие из них использовать. … Таким образом, вы можете создать персонализированный репозиторий инструментов, которые, вероятно, вам интересны».

«Есть причина, по которой вся эта история с GenAI началась с веб-браузера, верно?» добавил он, ссылаясь на ChatGPT. «Он начинался не как встроенное приложение, это был веб-интерфейс».

Наступающий «момент ага» для веб-ИИ

Локальный ИИ, похоже, является основной тенденцией, движущей более широкой тенденцией в области веб-ИИ. Ближе к концу нашего разговора Мэйс заметил, что «в какой-то момент у нас будет модель будущего, которая будет так же хороша, как сегодняшние облачные модели». [but] который подходит для устройства». Он сослался на недавние достижения в области мощности моделей Gemma от Google, которые достаточно легкие, чтобы работать на ноутбуках и даже телефонах.

Мэйс считает, что когда мы дойдем до того, что сложные модели смогут работать на устройствах, организации начнут задаваться вопросом, нужны ли им вообще облака для ИИ.

«Возможно, в 95% случаев использования вам не потребуется делегировать полномочия в облако».

— Джейсон Мэйс

«Да, могут быть некоторые новые достижения», — сказал Мэйес. «Всегда будет что-то новое и интересное для запуска в облаке, что не подходит для устройства, или какая-то современная вещь, но, возможно, для 95% случаев использования вам не придется делегировать полномочия в облако. И именно тогда вы начнете видеть, что у многих людей возникает этот момент ага, и они открывают для себя веб-ИИ».

ТЕНДЕНЦИОННЫЕ ИСТОРИИ YOUTUBE.COM/THENEWSTACK Технологии развиваются быстро, не пропустите ни одной серии. Подпишитесь на наш канал YouTube, чтобы смотреть все наши подкасты, интервью, демонстрации и многое другое. ПОДПИСАТЬСЯ Группа, созданная в Sketch. Ричард Макманус — старший редактор The New Stack и пишет о тенденциях в разработке веб-приложений и веб-приложений. Ранее в 2003 году он основал ReadWriteWeb и превратил его в один из самых влиятельных в мире новостных сайтов о технологиях. С самого начала… Подробнее от Ричарда Макмануса