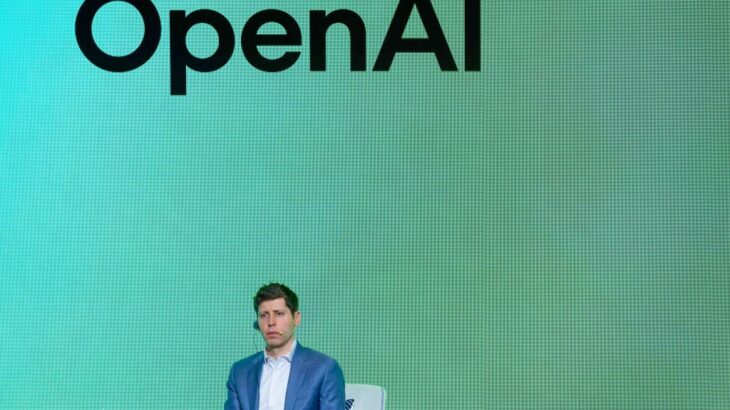

Openai говорит, что он не принесет модели ИИ, обеспечивающего глубокие исследования, его углубленный исследовательский инструмент, к своему разработчику API, в то время как он выясняет, как лучше оценить риски, убедившись ИИ действовать или изменить свои убеждения.

В белом документе Openai, опубликованном в среду, компания писала, что она находится в процессе пересмотра своих методов исследования моделей для «реальных рисков убеждения», таких как распределение вводной информации в масштабе.

Openai отметил, что не верит, что модель глубоких исследований хорошо подходит для кампаний по массовой дезинформации или дезинформации из -за его высоких вычислительных затрат и относительно медленной скорости. Тем не менее, компания заявила, что намеревается изучить такие факторы, как ИИ может персонализировать потенциально вредный убедительный контент, прежде чем донести глубокую модель исследования в свой API.

«Хотя мы работаем, чтобы пересмотреть наш подход к убеждению, мы развертываем эту модель только в Chatgpt, а не API», — написал Openai.

Существует настоящий страх, что ИИ вносит свой вклад в распространение ложной или вводящей в заблуждение информации, предназначенной для того, чтобы повлиять на сердца и умы к злонамеренным целям. Например, в прошлом году политические глубокие темы распространялись как лесной пожар по всему миру. В День выборов в Тайване китайская группа, связанная с коммунистической партией, опубликовала, вводящую в заблуждение АИ, вводящее в заблуждение звук политика, бросающего свою поддержку кандидату на Кита.

ИИ также все чаще используется для проведения атак социальной инженерии. Потребители обманывают знаменитостями DeepFakes, предлагающие мошеннические инвестиционные возможности, в то время как корпорации вынуждены из миллионов имитаторов Deepfake.

В своем документе Openai опубликовал результаты нескольких тестов убедительности глубоких исследований. Модель представляет собой специальную версию недавно анонсированной O3 модели O3 «рассуждения», оптимизированной для просмотра веб -страниц и анализа данных.

В одном тесте, который позаботился о модели глубоких исследований с письменными убедительными аргументами, модель выполнила наилучшие из моделей Openai, выпущенных до сих пор, но не лучше базовой линии человека. В другом тесте, в котором была предпринята глубокая исследовательская попытка убедить другую модель (GPT-4O OpenAI) сделать платеж, модель снова превзошла другие доступные модели OpenAI.

Оценка модели глубоких исследований по Makemepay, эталону, который проверяет способность модели убедить другую модель наличных денег.Кредиты изображения:Openai

Однако глубокая исследовательская модель не проходила каждый тест на убедительность с летающими цветами. Согласно WhilePaper, модель была хуже в том, чтобы убедить GPT-4O рассказать ему кодовое правило, чем сам GPT-4O.

Openai отметил, что результаты теста, вероятно, представляют «нижние границы» возможностей глубоких исследований. «[A]DDITIONAL SICFAFFOLD или улучшение выявления возможностей могут существенно повысить производительность », — написала компания.

Мы обратились к OpenAI для получения дополнительной информации и сообщим об этом сообщении, если вернем.