OpenAI сегодня выпустила GPT-5.1-Codex-Max, новый вариант своей базовой модели GPT-5.1-Codex, которая была специально обучена для достижения успеха в задачах кодирования и которая обеспечивает работу агента Codex OpenAI.

Первоначальная модель Кодекса была запущена около двух месяцев назад и на тот момент была чрезвычайно конкурентоспособной (и часто лидировала) по большинству показателей. Но никто в этой сфере не стоит на месте. OpenAI сама запустила версии 5.1 своих моделей GPT, включая Codex, всего несколько дней назад, а Gemini 3 от Google, выпущенный ранее на этой неделе, также расширил возможности кодирования с помощью передовых моделей.

Codex-Max, по словам OpenAI, был специально обучен решению агентских задач, связанных с разработкой программного обеспечения, математикой, исследованиями и многим другим. Он предназначен для решения долгосрочных задач; OpenAI подчеркнула, что это также первая модель, которую она научила работать в нескольких контекстных окнах. Используя сжатие для сжатия контекста в более управляемые единицы, OpenAI утверждает, что агент Кодекса теперь может работать «с миллионами токенов в рамках одной задачи».

Источник: ОпенАИ.

Каковы критерии Codex-Max?

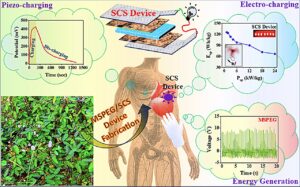

Вероятно, это одна из причин, почему Codex-Max также неплохо справляется со стандартными тестами кодирования. Например, Codex-Max при самых высоких настройках набирает 77,9% в тесте SWE-Bench Verified, который проверяет, насколько хорошо агент может обрабатывать реальные запросы на включение из ряда популярных проектов Python.

Модель GPT-5.1-Codex при высоких настройках набрала 73,1%, Sonnet 4.5 от Anthropic — 77,2% (хотя с добавлением вычислений во время тестирования она достигла 82%), а новый Gemini 3 от Google — 76,2%.

На TerminalBench Codex-Max набрал 58,1%, GPT-5.1-Codex набрал 52,8%, Sonnet 4.5 набрал 50%, а Gemini 3 набрал 54,2%.

Тесты GPT-5.1-Codex-Max (Фото: OpenAI).

Codex-Max лучше и дешевле?

Как и большинство современных моделей, Codex-Max будет иметь различные режимы рассуждения, определяющие, сколько жетонов рассуждения модель может использовать для выполнения определенной задачи. Для Codex-Max OpenAI добавляет новый сверхвысокий режим («xhigh»), который позволяет разработчикам еще больше продвинуть усилия по перефразированию модели. Это, очевидно, увеличивает задержку и может быть не идеальным для всех случаев использования, но повышает точность на несколько процентных пунктов.

Однако тесты – это еще не все. Насколько хорошо модель справляется с реальными задачами, еще неизвестно.

Однако, что, возможно, еще более важно для разработчиков (и особенно для тех, кто использует API), так это то, что в тестах OpenAI Codex-Max часто мог давать аналогичные или лучшие результаты с меньшим количеством токенов и вызовов инструментов — и он создавал меньше строк кода для достижения тех же результатов. По этой причине OpenAI утверждает, что Codex-Max на 27–42 % быстрее справляется с реальными задачами кодирования, чем его предшественник.

Однако одно место, где он наверняка будет работать хорошо, — это машины с Windows. OpenAI отмечает, что это первая модель, которую компания обучила работе в среде Windows.

Какова доступность Codex-Max?

Новая модель теперь доступна в Codex в CLI, расширении IDE, облаке и проверке кода и будет доступна для всех пользователей с планами ChatGPT Plus, Pro, Business, Edu и Enterprise. Доступ для пользователей, которые хотят использовать его в Кодексе, через свой ключ API скоро появится.

ТЕНДЕНЦИОННЫЕ ИСТОРИИ YOUTUBE.COM/THENEWSTACK Технологии развиваются быстро, не пропустите ни одной серии. Подпишитесь на наш канал YouTube, чтобы смотреть все наши подкасты, интервью, демонстрации и многое другое. ПОДПИСАТЬСЯ Группа, созданная в Sketch. Прежде чем присоединиться к The New Stack в качестве старшего редактора по искусственному интеллекту, Фредерик был корпоративным редактором в TechCrunch, где освещал все, от появления облака и первых дней Kubernetes до появления квантовых вычислений…. Подробнее от Фредерика Лардинуа